4月26日消息,随着ChatGPT等生成式人工智能的出现,越来越多的用户在享受便利的同时发现,AI经常会出现“一本正经的胡扯”的现象,有时甚至会有一些让人细思极恐的发言。

近日,NVIDIA推出了一款名为NeMo Guardrails的软件,它能够为人工智能模型设置安全“护栏”,避免AI输出一些不良的内容。

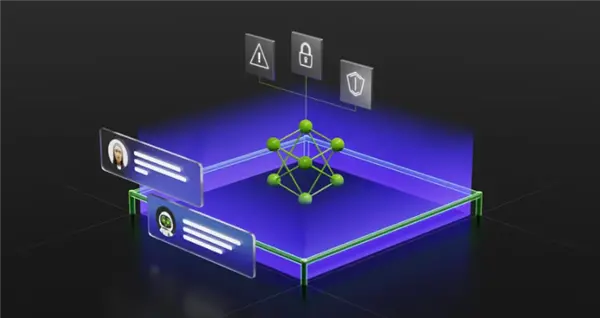

据悉,NeMo Guardrails的本质是一个位于用户和模型之间的软件层,它能够在模型输出不良内容前进行拦截和修改。

比如,如果用户需要一个针对特定方向的AI,就可以利用该软件,来限制AI至输出对应方面的内容,而不谈论不相关的话题。

此外,该软件还能够利用一个AI模型检测另一个AI模型,如果两个模型输出的答案不一致,软件将直接输出“我不知道”的回答。

通过这种方式,人工智能“胡说八道”的情况会得到有效降低,一些可能存在危险的回复也能够被直接拦截。

【来源:快科技】