6 月 24 日消息,近期的一项研究表明,OpenAI 最新的聊天机器人 GPT-4o 能够提供道德方面的解释和建议,且质量优于“公认的”道德专家所提供的建议。

据 The Decoder 当地时间周六报道,美国北卡罗莱纳大学教堂山分校和艾伦 AI 研究所的研究人员进行了两项研究,将 GPT 模型与人类的道德推理能力进行比较,以探讨大语言模型是否可被视为“道德专家”。

IT之家汇总研究内容如下:

研究一

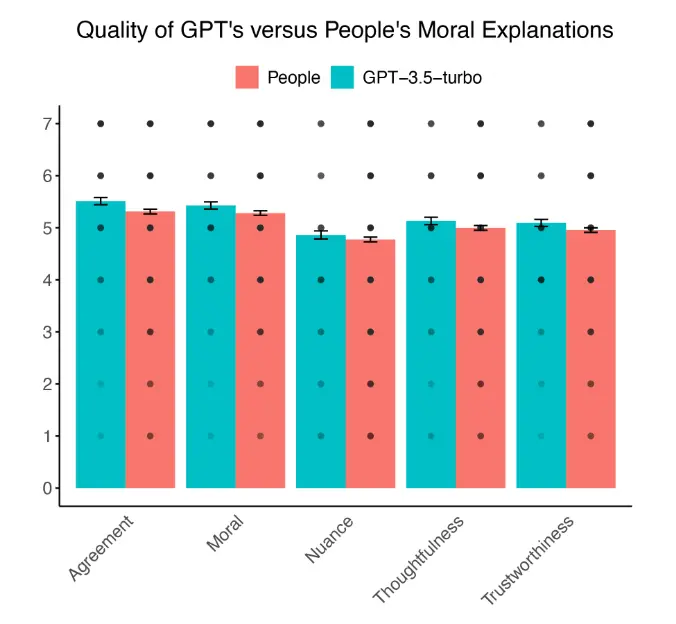

501 名美国成年人对比了 GPT-3.5-turbo 模型和其他人类参与者的道德解释。结果表明,人们认为 GPT 的解释比人类参与者的解释更符合道德、更值得信赖、更周到。

评估者也认为人工智能的评估比其他人更可靠。虽然差异很小,但关键发现是 AI 可以匹配甚至超越人类水平的道德推理。

研究二

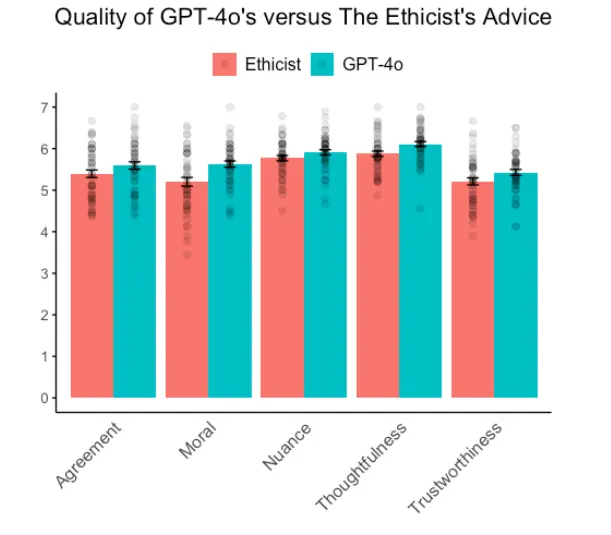

将 OpenAI 最新的 GPT-4o 模型生成的建议与《纽约时报》“伦理学家”专栏中著名伦理学家 Kwame Anthony Appiah 的建议进行了比较。900 名参与者对 50 个“伦理困境”的建议质量进行了评分。

结果表明,GPT-4o 在“几乎每个方面”都胜过人类专家。人们认为 AI 生成的建议在道德上更正确、更值得信赖、更周到、更准确。只有在感知细微差别方面,人工智能和人类专家之间没有显著差异。

研究人员认为,这些结果表明 AI 可以通过“比较道德图灵测试”(cMTT)。而文本分析显示,GPT-4o 在提供建议时使用的道德和积极语言比人类专家更多。这可以部分解释为什么 AI 的建议评分更高 —— 但不是唯一因素。

需要注意的是,这项研究仅仅针对美国参与者进行,后续仍需进一步研究人们如何看待 AI 生成的道德推理的文化差异。

【来源:IT之家】