无界算力,共创数智未来——青云 2024 AI 算力发布会成功举办,全面展示了青云在 AI 算力领域的产品创新、生态建设及场景落地成果。

青云科技副总裁沈鸥以《跨界融合,共生共赢》为主题分享了青云的生态战略、合作矩阵,以及在智算生态上取得的进展。

以下为分享内容,经整理。

过去的一年里,人工智能产业发展迅猛。各地大力建设智算中心,以满足不断增长的算力需求。仅今年上半年公开招标的数据中心就超过 150 个;各类模型发布应接不暇,截至今年 6 月,国内完成备案的大模型数量已超 140 个。借助 AI 基础设施和大模型的强大能力,众多新需求、新场景不断涌现,大家都期望推动产业发展,让技术融入生产。

回顾 AI 2.0 大潮产生的原因,主要由 ChatGPT 引发。那么,ChatGPT 究竟是产品还是工具?ChatGPT 由两大部分构成:一是 GPT 部分,即大模型,如 OpenAI 以及国内外众多大模型;二是至关重要的部分 ——Chat,它是人机交互的应用界面,无需通过代码,只需简单沟通即可获得结果。这也是 ChatGPT 流行的原因,它让复杂技术以一种极为简单、人人可用的方式被大众接受。

青云看到,要让一项技术真正落地,就需将其与实际场景、具体业务相结合,解决客户实际问题,这也是青云这样的技术公司与合作伙伴共同努力的方向。

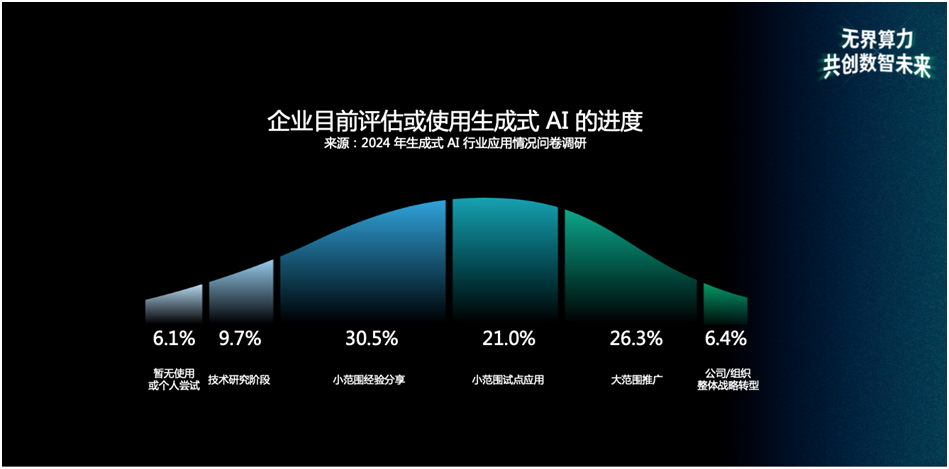

再来看一下 AIGC 在企业应用的情况,数据表明,超过一半的企业已经在各个场景中积极尝试 AI 相关的新应用。青云深刻认识到,若要参与这场革命,像青云这样的技术平台公司单打独斗肯定是不行的,需要生态合作伙伴的助力,让技术能力与生态能力相结合,完成客户业务目标的 “最后一公里”,解决实际问题,充分发挥 AI 的价值。

去年 9 月,青云科技举办了 AI 智算 1.0 发布会,提出 “商业进化需要融合多样性的生态能力”。那时,我们就已看到生态在 AI 智算领域的价值,在此后的一年里,青云除了打磨自身的产品与服务,也积极与相关领域的企业进行技术对接和验证,共同落地创新项目。

青云先后推出了算力共赢计划、算力加速计划、模型市场共建计划等,完成生态适配 138 项,现有 AI 生态合作伙伴超过 200 家,使我们能够服务于各种行业的各类场景。

联合算力设备商,打造算力基石

算力层面,青云持续广泛地与国内外算力设备供应商合作,与其产品进行适配对接。

此前介绍产品时提到的 AI 智算平台,已支持英伟达的全线产品。我们还与英特尔合作开展课题,研究如何在其 CPU 加速器上实现 AI 场景加速。

同时,我们与国内的 CPU、GPU、DCU、NPU 厂商进行了大量技术对接和验证工作,包括华为昇腾、海光、燧原、摩尔线程、海飞科等公司。例如,青云与海光进行了全面合作,青云 AI 智算产品、GPU 虚拟化等能力已全面支持海光 K100、Z100 等产品,在青云的 AI 算力云服务上,上架了海光 DCU 资源,提供给海光生态合作伙伴,使其能在云服务环境中更快地验证对海光 DCU 的适配。青云适配了华为昇腾 910B、310 等 GPU,并且在国内大型金融机构全面验证了对其的技术支持能力,得到了客户的高度认可。青云产品适配了燧原二代卡,后续正计划适配三代卡。其它厂商的适配验证工作也有序进行。

青云科技与国产 GPU、DCU 厂商展开的深入合作,将为客户带来快速交付和更好的建设性价比,客户可以一站式获得多种国产卡的运行支持、模型开发和模型运行的完整能力。我们看到,以传统 CPU 为主的云计算信创已拓展到智算领域,青云科技也希望通过与合作伙伴的 合作,更好地发挥国产智算的能力。

联合大模型和加速厂商,丰富业务场景创新

在模型服务层面,青云与大模型厂商合作,在 MaaS (模型即服务)平台上架了多款大模型服务。在金融等行业,青云与智谱深入探讨了如何让行业客户从了解常见的 AI 应用,到将 AI 真正落地到行业场景中,这是一条漫长的路,需要从企业内部数据的重新整理到流程的重构, 合作才能全面发挥模型的能力和价值。青云与模型加速企业合作,希望让用户通过青云智算平台更快、更流畅地使用模型服务。如与潞晨科技合作完成了山东的一个大型政府项目的落地,由于前期双方已有合作,使我们成为最快通过验收的企业。此外,青云也与中科加禾就异卡环境下如何更好地实现模型一致性交付等方面展开合作。

通过与各方伙伴合作,青云努力提供满足多行业需求的的智算与 AI解决方案。同时,由于 AI 的快速发展,应用程序的开发出现了新范式。以前 AI应用开发门槛高,需要专业和有经验的开发人员。现在可以通过基于大模型的开发工具,如 Cursor、通义零码,可以快速进行应用程序的开发工作,许多个人开发者或初创企业比以往更容易地实现新想法的落地。为此,很多创业公司需要原始的 AI PaaS能力,能按照自己的业务理解与规划设计进行组装,从而满足自己的业务场景需求。

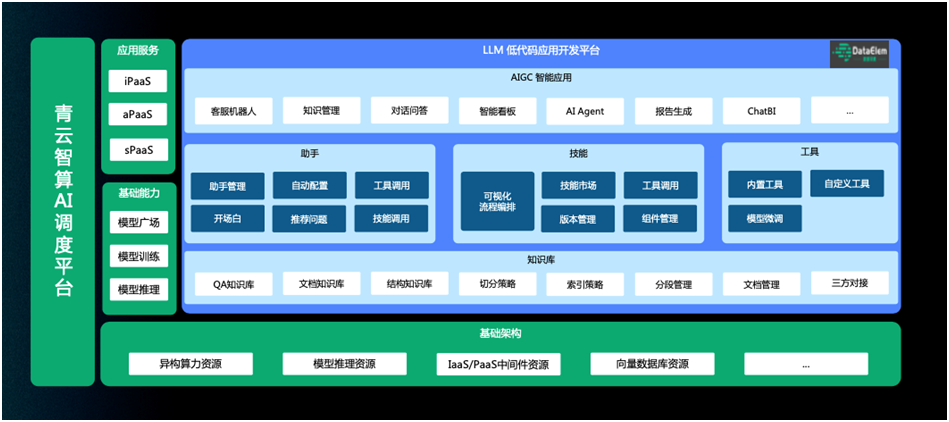

因此,青云今年有一个团队致力于打造 AI PaaS 平台服务。在这个平台上,我们将对常见的AI场景进行拆解为语音识别、语音合成、数据向量化、PDF 解析等原子化AI能力,所有这些被称为小模型或专业的原子性模型服务能力将逐步上线。通过结合青云的开发平台以及后面将介绍的 AI 应用开发工具链,客户的具体需求可以快速与这些能力结合,实现自己的应用场景。只有业务场景越丰富,我们认为 AI 才能真正推动业务创新迭代。

联合数据要素厂商,全面支撑 AI 应用开发

在数据层面,随着 AI 智能体的发展,重构业务的数据分析能力已逐渐成为现实。青云与国内一些数据要素厂商、AI 开发链厂商合作,希望打造全面的数据服务和应用开发服务。

基于大模型的数据分析与传统数据分析不同,基础大模型在支持数据分析应用开发的方面发挥了很大作用,基于大模型分析相关数据,叠加新的流程、对接新的接口,可以快速支持业务。

以青云与北京数据项素公司在AI 应用生态链中的合作为例,数据项素的“毕昇”提供了大量的 AI Agent,支持 AI 大模型应用场景。我们的合作基于双方 产品集成,最终为客户提供一站式整体交付方案。无论是在 CoresHub (青云 AI 算力云)还是本地私有化部署中,客户都能获得 AI 应用开发的完整能力。

联合行业 ISV,服务“人工智能+” 行动

去年,政府提出“人工智能+ ” 行动倡议,政府大力倡导将人工智能作为新质生产力来支持和推动产业的创新、迭代和升级。青云科技在这一领域与许多行业 的ISV 展开了合作。

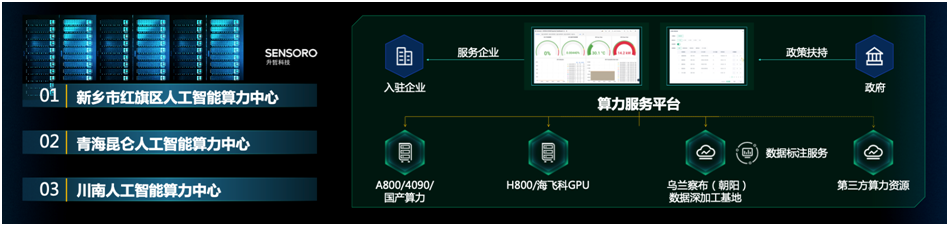

例如,青云与升哲科技有着长期合作关系,共同打造完整解决方案。在过去两年中,双方共同完成了三个政府智算中心的建设工作。在这些智算中心建设项目中,升哲科技提供了一整套的端到端的服务能力,包括民生管理平台、城市安全数据的分析能力,这些都部署在青云 AI 智算平台上。双方的合作推动了政府管理工作、政务工作的数智化,使得智算的落地切实有效,确保智算中心的算力真正服务于民生,实现政府服务升级。

青云科技还与数道智算等同样扎根北京的企业合作,希望联合打造算力互联平台,提供融合算力服务,为北京智算产业发展贡献自己的力量。

技术底座开源开放,连接广泛生态

在探讨青云科技生态建设的基础时,我们首先要明确,为企业提供数智化服务的关键在于打造坚实的技术底座,青云始终高度重视技术底座的自主研发。在当今的 AI 领域,云原生已然成为广泛的技术共识,而这也正是青云科技生态建设的核心底座。

自 2018 年起,青云就开启了云原生底座的自主研发之路,以开源项目 KubeSphere 为基石,成功构建并运营了具有全球影响力的云原生开源社区。云原生不仅为 AI 智算平台提供技术底座,还充分运用 LuBan 应用框架、Whizard 可观测性平台等能力,极大地简化了与第三方生态合作的对接和验证过程,同时有力地保障了整个平台的性能监测与故障诊断。

正是由于与客户在技术认知上保持同频,使得我们的技术在企业的实际应用中能够更加顺利地落地。而过去十多年,青云在企业数智化工作中的积累以及持续的自主研发,为如今的生态对接奠定了坚实基础,让青云在 AI 智算领域抢占了先机。可以说,KubeSphere 的深厚积累使得青云在智算方面具备了独特优势,便于生态合作的广泛开展。

新技术的不断涌现正推动着 AI 行业不断向前发展,现在只是整个 AI 革命的初期阶段。算力无界,合作跨界,青云希望与所有合作伙伴共同努力,建设共生共赢的生态,为人工智能的发展尽已所能、展己所长。