2025年11月的某个傍晚,在宾夕法尼亚州蒙图尔县的一次规划会议上,聚集了300多名当地居民。当时,塔伦能源公司正计划在该县兴建一个容纳12至15栋建筑的大型数据中心,而居民们对此表示强烈抗议。

原因之一,是数据中心的建设,正在推高居民日常生活的电价。联邦政府数据显示,宾州电价过去一年间激增15%。一些分析师警告,电价今后数年还可能显著提高。

不只是宾州,据美国独立研究机构“数据中心观察”统计,仅2025年第二季度,全美就有约20个数据中心项目被叫停或推迟,预算总额或达980亿美元。

居民电价上涨已成为美国AI发展的一个社会性问题。政府与产业需要大规模数据中心建设来维持在AI领域的竞争力,而民众则质疑自己是否应该为能源需求激增导致的电价上涨买单。

如今,问题迎来了解决契机。据美国阿克西奥斯新闻网站25日报道,多家技术巨头企业代表拟于下周前往白宫,签署书面文件,承诺自行供应或购买AI数据中心所需电力,以免推高民用电价。

社会问题解决了,但产业却可能面临新的问题。电力成本是AI数据中心运营成本的核心组成部分,占比高达50%-60%。电费自负后,AI企业的能源支出从“可变成本”转变为“刚性固定成本”,自建电等额外投入进一步推高了单位算力成本。

这对OpenAI、Anthropic等头部初创企业的压力尤其明显。OpenAI去年毛利率从40%降至33%,远低于预测的46%;Anthropic虽大幅改善了负毛利状况,但2025年的预计毛利率40%,仍较目标低10个百分点,算力成本的失控是两家企业盈利困境的主因。

因此,这次自负电费文件的签署,或成为AI产业从“规模扩张优先”转向“成本可控、能效至上”的关键转折点。而联想集团等算力基础设施供应商,凭借其在“降本、提效、节能”方面的领先能力,正站在这场产业变革的风口。

AI算力的降本之路

当电费成为AI企业不可回避的刚性支出,成本压力面前,AI企业将不得不形成这样一个新的认识:谁能帮它们省电、省钱,谁就是它们最需要的合作伙伴。而这恰恰将算力基础设施硬件厂商推到了舞台中央,其背后是三层清晰的产业逻辑。

首先是液冷技术将加速渗透。

AI数据中心的散热系统能耗占比高达40%左右,是节能降本的重头戏。尽管液冷方案初次投入成本,比风冷方案高出15%至50%,但长期来看,其强劲的节能效益足以覆盖前期投入,并能持续降低电力消耗带来的刚性成本。

对于AI企业而言,一台液冷服务器全生命周期可节省数十万度电,大型智算中心年节电可达千万度级别,这种“节能即降本”的优势,在电费自负时代显得尤为重要。这也是芯片商、云厂商愿意主动投入使用液冷技术的核心原因。

而对于硬件供应商来说,液冷方案更高的初次投入成本,实际上也意味着更丰厚的销售收入。这吸引了联想集团等头部厂商主动加码布局。比如,联想集团的海神液冷技术,已经进化到第六代,飞鱼仿生散热设计也在2025年初露头角,公司借此不断提升产品竞争力以抢占市场份额。

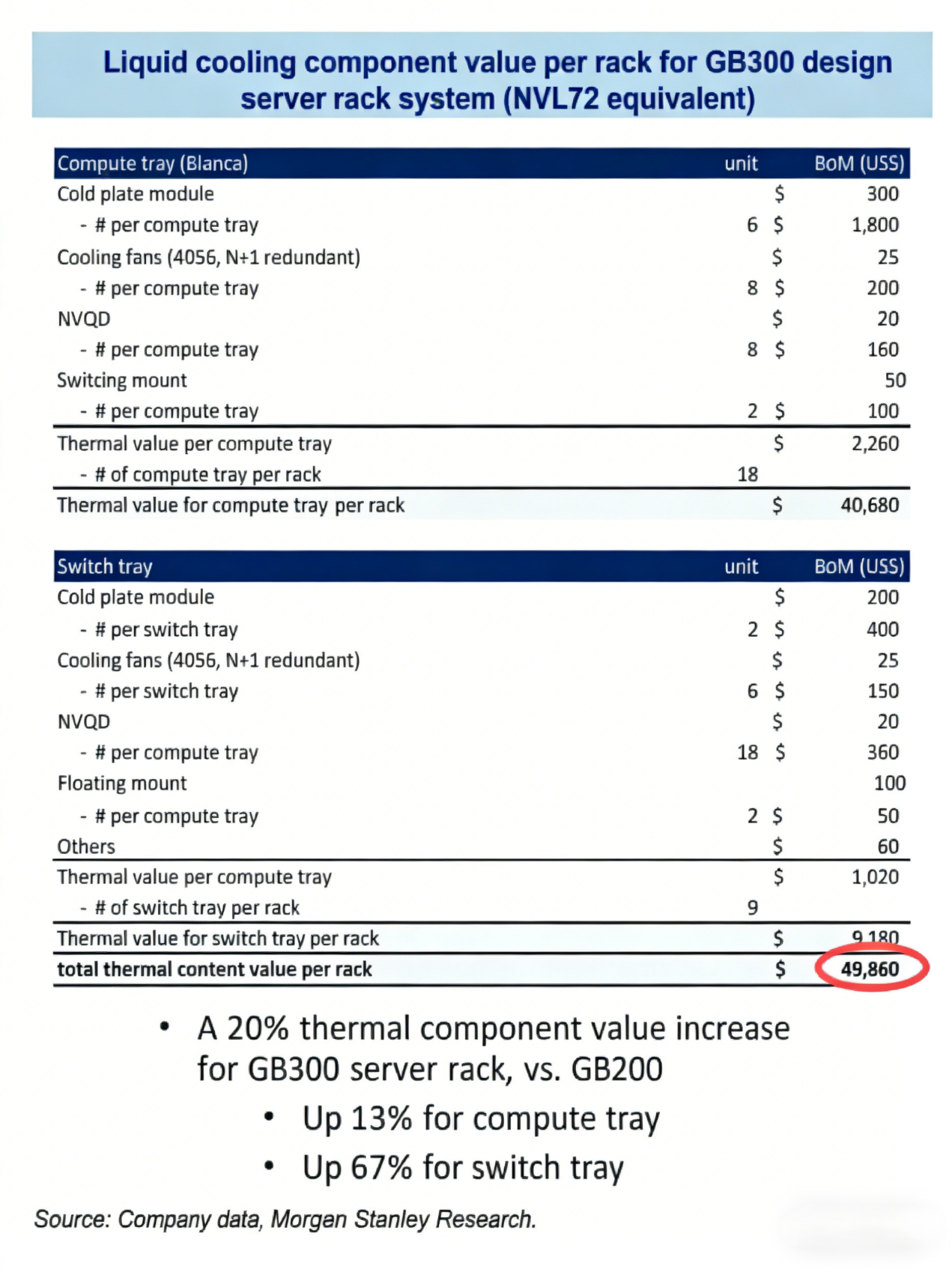

并且,更高能量密度的芯片架构,所需的液冷散热组件价值也更高。根据摩根士丹利报告,英伟达GB300 NVL72机架级AI系统的液冷散热组件价值高达49860美元,比GB200 NVL72系统高出约20%,下一代Vera Rubin NVL144平台的散热总价进一步增长17%,达到约55710美元。当联想集团的海神温水冷、飞鱼仿生散热设计等应用到这些更新的芯片架构上时,其盈利水平也将随之水涨船高。

供方因为更高的系统价值愿意投入更先进技术,需方因为长期的节能效益愿意覆盖初次投入成本——这两股力量同时加码,液冷的渗透速度只会越来越快。

第二层逻辑,是算力降本从“单点优化”向“系统升级”的转型,催生系统集成产品的爆发。

当单一硬件的优化空间逐渐见顶,对于云厂商而言,与其花费大量精力整合不同品牌的硬件、软件与服务,不如选择具备高效集成能力的厂商,实现算力系统的整体降本增效。这就催生了像联想与英伟达在今年CES上联合发布的“AI云超级工厂”这类系统集成产品。

这种“超级工厂”模式,本质是用工业化效率解决AI算力的成本难题,通过高度集成减少冗余、提升利用率、缩短周期,让每一度电、每一块硬件都发挥最大价值。当数据中心规模扩大到万卡、十万卡级别时,其作用便显现了出来。从落地效果来看,联想集团与燧弘华创合作部署的庆阳国产燧原大型集群,整体算力利用率提升40%以上,运营成本反而降低30%。

英伟达CEO黄仁勋与联想集团CEO杨元庆立下的全新合作目标——未来三年内,将双方的业务合作规模扩大至原来的4倍,背后不仅是对算力市场高增长需求的乐观预测,也是对这种高效集成能力产业价值的饱满信心。

第三层逻辑,是供应链把控能力成为算力硬件厂商的核心竞争力。

AI算力硬件的核心原材料,如GPU、存储芯片、HBM等,近年来受市场需求爆发影响,价格波动剧烈。对于依赖上游组件的硬件厂商而言,能否有效把控供应链,平滑原材料价格波动带来的风险,直接决定了企业的成本竞争力。

而联想集团、戴尔这类大规模企业,凭借其分布式供应链体系与大规模采购优势,在这场供应链博弈中占据了上风。比如,联想集团“全球资源,本地交付”的模式,使其采购与交付不押注于单一地理节点,而是通过多区域、多中心的体系化配置,整合全球资源,对冲局部供应链波动的风险。

同时,联想集团凭借全球PC市场25.3%的份额,以及覆盖PC、手机、服务器等多条业务线的合并采购规模,在核心元器件采购上拥有极强的议价权,且能够通过提前签署年框,将核心内存库存储备于表内,转化为实物资产,从而获得宝贵的“成本时差”。

这就是摩根士丹利等国际投行将联想集团评为“抵御存储成本上涨风险的最佳公司”的原因。在能源成本与零部件价格双重上涨的背景下,联想集团的供应链优势,正转化为客户的成本确定性优势,成为吸引云厂商、AI 企业、大型企业客户的关键竞争力。

综合来看,在AI企业成本逻辑之下,算力硬件供应商的价值,将不只是卖高性价比,还在于卖长期持续性的运营降本。

终端用户的差异化选择

算力成本的压力不会只停留在云厂商这一层,它必然会顺着产业链往下传导。

亚马逊、谷歌、优刻得已经吹响了云服务涨价的前哨,打破公有云多年来的降价传统。接下来,那些依赖云服务的中小企业和开发者,会发现自己的账单越来越烫手。

当传统“全部上云”的模式不再经济,用户自然会开始寻找更便宜的算力供给方案。这就带来了第二个结构性机会——算力需求开始分层、外溢、下沉,从公有云向企业级数据中心、边缘计算、端侧算力扩散,形成“云端-边缘-端侧”协同的算力新格局。

道理很简单,不是所有的AI任务都需要跑到云端去跑。实时性要求高的、数据隐私敏感的,或者算法相对固定的场景,把算力放在本地可能更划算。比如工厂里的质检摄像头、门店里的实时客流分析,这些任务如果每张图都传到云端去推理,成本根本兜不住。

对于大型企业与机构而言,采购几台联想集团的ThinkSystem机架式、塔式服务器,搭建私有云与混合云,能够实现算力自主掌控,长期总拥有成本(TCO)远低于公有云;对于金融、制造、医疗等对延迟、安全敏感的行业客户,联想集团的企业级基础设施,也能够实现算力本地化、业务自主化,满足行业合规要求;对于面临推理成本压力的AI创业公司,采用“联想智算基础设施+自研模型”的混合部署模式,更能够有效降低单位算力成本,缓解盈利压力。

这就是联想集团“稳固云基础设施+拓展企业基础设施”双轨战略的优势所在。它为客户提供的,不仅是能效、性价比的确定性,更是对不同场景需求的精准适配和高度灵活性。

边缘侧的机遇,则除了规避云服务涨价带来的成本拉力之外,还在于对工业互联网、智能驾驶、零售终端、远程办公等场景实时算力需求的响应。在工厂、门店、基站等严苛环境中,联想集团的一台ThinkEdge SE100边缘服务器,比之谷歌、亚马逊等厂商的云服务,更能实现数据就近处理,减少云端传输与算力成本,推动算力普惠。

更底层的变化发生在端侧。随着AI智能体的普及,单次任务的推理次数呈指数级上升。如果每一次交互都往云端送,成本无法想象。因此,将部分推理能力下沉到终端设备,成了必然选择。

在AI PC、AI手机、AI平板、可穿戴设备、工业设备上部署的AI算力,不仅无需依赖云端传输,降低了云端算力的使用成本,还能提升数据处理的实时性与安全性,尤其适合对数据隐私要求较高、需要实时响应的场景,如工业制造、医疗健康、智能终端等。

特别是联想集团等龙头企业构建的AI互联生态,正在释放更大的终端算力价值。比如在联想集团的“一体多端”战略之下,用户可以在PC上进行AI内容创作,在手机上接收AI指令提醒,在平板上进行精细化修改,在AIoT设备上实现场景化联动。

尽管单个终端设备的算力可能无法支撑整体工作任务,但这种多设备互联生态,可以弥补不同设备的短板,让用户在本地就能高效处理AI翻译、AI摘要、实时数据分析这些任务,不用每次都给云厂商交“过路费”,体验反而更好,数据也更安全,长期成本还更低,端侧算力的价值便凸显出来了。

从行业发展逻辑来看,终端用户的差异化选择,本质上是成本逻辑驱动下的产业升级。过去,算力产业的竞争核心集中在云端算力的规模与性能上,但随着成本压力的凸显,算力的“去中心化”成为了新的趋势,云端、边缘、端侧协同发展的混合式AI算力架构,将成为未来的主流。

算力硬件企业的竞争壁垒,也在这一过程中发生重构。单纯硬件参数的比拼已经落伍,“降本能力+场景覆盖+全栈服务”的综合实力比拼开始走上前台。联想集团这类企业的核心优势,也正在于其“全场景、全链路”的布局:面向云端,公司有液冷服务器、AI超级工厂等产品与方案,帮助云厂商、AI企业降低基建与能源成本;面向企业级市场,有ThinkSystem系列服务器,承接算力回流需求;面向边缘与端侧,有ThinkEdge边缘服务器、AI终端等产品,承接算力下沉需求。

这种多场景、全覆盖的能力,是单一云厂商或硬件厂商难以比拟的。当终端用户不再满足于公有云的单一供给,而是追求 “性价比、低延迟、自主性” 的差异化选择时,联想集团的全栈布局恰好承接了这部分外溢需求,使其在这轮成本重构的浪潮中占据主动地位。。

由此回望这场由“自负电费”引发的算力产业变革,不难发现,成本压力从来都不是产业发展的阻碍,而是推动技术创新与产业升级的动力。美国AI巨头的电费负担,催生了算力基础设施的降本需求,也推动了液冷技术、系统集成、供应链管理等领域的进步;而终端用户的差异化选择,则让算力产业从“单一云端”走向“多元协同”,开启了全场景算力的新时代。